AI Ararken RedLine Yüklemeyin

OpenAI ChatGPT ve Midjourney gibi generatif AI hizmetleri için kötü niyetli Google Arama reklamları, RedLine Stealer kötü amaçlı yazılımını dağıtmak amacıyla kullanılıyor.

eSentire analizine göre, "Her iki AI hizmeti de son derece popüler olmasına rağmen bağımsız uygulamalara sahip değillerdir (yani kullanıcılar ChatGPT'ye web arayüzü üzerinden erişirken Midjourney Discord'u kullanır)," dedi.

"Tehdit aktörleri, sahte uygulamaları tanıtan sahte web sayfalarını tanıtan AI uygulama arayıcılardan yararlanmışlardır."

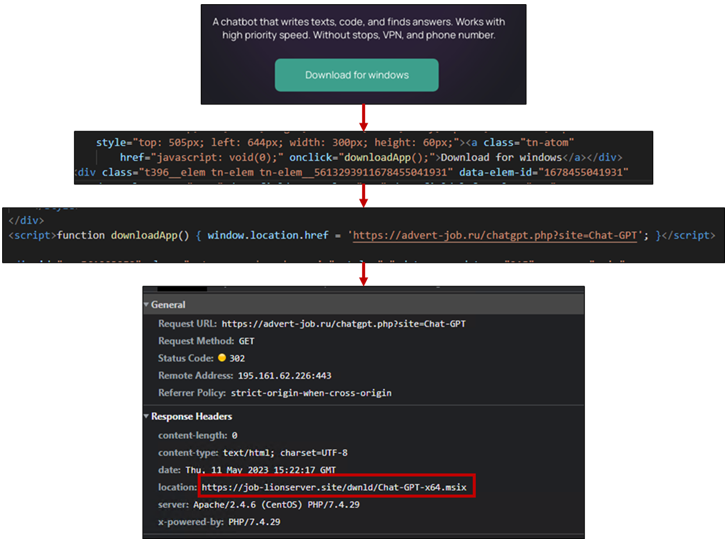

BATLOADER, kullanıcıların arama motorlarında belirli anahtar kelimeler aradıklarında sahte reklamların görüntülendiği ve tıkladıklarında kötü amaçlı yazılım barındıran yanıltıcı indirme sayfalarına yönlendirildikleri drive-by indirmeleri aracılığıyla yayılan bir yükleyici kötü amaçlı yazılımdır.

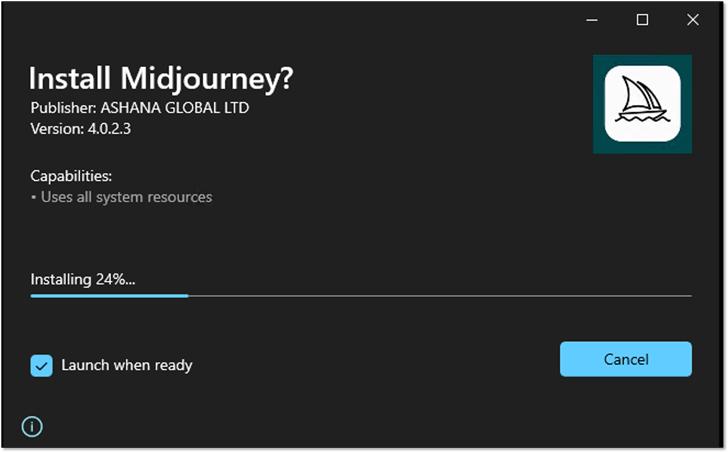

eSentire'a göre, kurulum dosyası, ChatGPT.exe veya midjourney.exe adlı bir yürütülebilir dosya ve Chat.ps1 veya Chat-Ready.ps1 adlı bir PowerShell komut dosyası içerir ve uzaktaki bir sunucudan RedLine Stealer'ı indirir ve yükler.

Kurulum tamamlandığında, ikili dosya Microsoft Edge WebView2'yi kullanarak chat.openai[.]com veya www.midjourney[.]com - yasal ChatGPT ve Midjourney URL'leri - pop-up penceresinde yükleyerek herhangi bir şüphe uyandırmadan açar.

Düşmanın, kötücül reklamlar sunmak ve sonuçta RedLine Stealer kötü amaçlı yazılımını bırakmak için ChatGPT ve Midjourney temalı tuzağı kullandığı da geçen hafta Trend Micro tarafından vurgulandı. Yapay Zeka Araçları BATLOADER'ın arkasındaki operatörlerin kötü amaçlı yazılım dağıtmak için yapay zeka çılgınlığından yararlandığı ilk kez değil. Mart 2023'te, eSentire benzer bir dizi saldırıyı ayrıntılı bir şekilde açıkladı, bu saldırılar Vidar Stealer ve Ursnif'i dağıtmak için ChatGPT tuzağından yararlandı.

Cybersecurity şirketi ayrıca Google Arama reklamlarının kötüye kullanımının 2023 başlarındaki zirveden düştüğünü belirtti, bu da teknoloji devinin bu tür kötüye kullanımları sınırlamak için aktif önlemler aldığını gösteriyor.

Bu gelişme, tehdit aktörlerinin kötü amaçlı yazılım ve diğer sahte uygulamaları dağıtmak için bu yapay zeka araçlarının artan kullanımından yararlanmaya çalıştığı daha geniş bir dolandırıcılık ve sahtekarlık kampanyası dalgasıyla uyumlu.

Güvenlik sağlayıcısı Sophos, ilgili bir araştırmada, Google Play ve Apple App Store'da ChatGPT ile ilişkili bir dizi fleeceware uygulamasını - toplu olarak FleeceGPT olarak adlandırılan - kullanıcıları istenmeyen aboneliklere zorladı.

Sophos araştırmacıları Jagadeesh Chandraiah ve Sean Gallagher, "Fleeceware uygulamaları, Apple ve Google hizmet şartlarının sınırlarında kalmak üzere tasarlandığı ve özel bilgilere erişmediği veya platform güvenliğini aşmayı denemediği için nadiren gözden geçirmede reddedilir ve uygulama mağazalarına alınır," dedi.

Son haftalarda, Meta ve Palo Alto Networks Unit 42, kullanıcıların kredi kartı bilgilerini toplamak, kredi kartı dolandırıcılığı yapmak ve kurbanların Facebook hesap bilgilerini çalan taklit ChatGPT hizmetine benzeyen sahtekarlık faaliyetlerinde artış olduğu konusunda uyarıda bulundu.